Data Labeling pour le Computer Vision

Boostez vos modèles de détection d'objets, de classification et de segmentation avec des jeux de données de la plus haute qualité. Innovatiana offre des services d'annotation d'images sur mesure pour vos projets d'intelligence artificielle

Nos experts en annotation de données pour l'IA allient rigueur, maîtrise technique et connaissance des outils avancés pour transformer vos images et vidéos en données exploitables pour vos modèles Computer Vision

Annotation d’images

Annotation de vidéos

Annotation 3D Point Cloud

Annotations médicales

Annotation d’images

Nous transformons vos données visuelles en ressources stratégiques grâce à une expertise humaine et technologique adaptée à chaque secteur.

Bounding Boxes

L’annotation de type Bounding Box consiste à délimiter précisément les objets d’intérêt dans une image à l’aide de rectangles, afin de permettre à un modèle de vision par ordinateur d’apprendre à les détecter ou les reconnaître automatiquement.

Définition du plan d’annotation et des classes d’objets à repérer

Annotation manuelle ou semi-automatisée par bounding boxes (images, vidéos, vues satellite, ...)

Validation croisée et contrôle qualité (cohérence des étiquettes, chevauchements, taux de couverture, ...)

Export des annotations aux formats standards (COCO, YOLO, Pascal VOC, …)

Inspection industrielle – Détection de défauts sur des pièces en production

Conduite autonome – Repérage de véhicules, piétons, panneaux de signalisation

Imagerie satellite – Localisation de bâtiments, zones agricoles ou forestières

Polygones

L’annotation par polygones permet de délimiter avec précision les contours complexes des objets dans une image (formes irrégulières, objets imbriqués, etc.), indispensable pour les modèles de segmentation d’instance ou sémantique.

Définition des catégories et des critères de segmentation

Annotation manuelle des objets par traçage de polygones point par point

Contrôle qualité et vérification croisée des contours et classes

Export dans des formats adaptés (COCO, Mask R-CNN, PNG masks, …)

Inspection industrielle – Détection précise des zones défectueuses

Conduite autonome – Segmentation des routes, trottoirs, véhicules

Imagerie satellite – Délimitation de cultures, bâtiments ou zones naturelles

Keypoints

L’annotation par keypoints consiste à placer des points de repère sur des zones précises d’un objet (ex : articulations humaines, repères faciaux, composants mécaniques) afin d’entraîner des modèles de détection de posture, de suivi de mouvement ou de reconnaissance fine.

Définition du squelette de points (nombre, nom, relations entre keypoints)

Placement manuel des keypoints sur chaque image ou séquence

Contrôle qualité sur la cohérence spatiale et les erreurs d’alignement

Export au format JSON ou COCO keypoints

Inspection industrielle – Repérage de composants ou capteurs précis sur des machines

Conduite autonome – Suivi des mouvements de piétons ou cyclistes

Santé / sport – Analyse de posture, gestes ou mouvements articulaires

Segmentation

L’annotation par segmentation vise à attribuer un label à chaque pixel d’une image pour permettre à un modèle de comprendre précisément les contours et la nature des objets, surfaces ou zones. Elle est essentielle pour des tâches de segmentation sémantique ou d’instance, utilisées dans les systèmes de vision les plus avancés.

Définition des classes à segmenter (objets, surfaces, matières, …)

Annotation pixel par pixel (manuelle ou assistée)

Contrôle qualité par relecture et harmonisation des contours

Export au format PNG mask, COCO segmentation, ou fichiers vectoriels

Inspection industrielle – Détection précise des zones à défauts ou usure

Conduite autonome – Segmentation fine de la chaussée, trottoirs, véhicules

Imagerie satellite – Classification de zones urbaines, naturelles ou agricoles

Polylignes

L’annotation par polylignes consiste à tracer des lignes continues sur des images pour représenter des structures linéaires telles que routes, contours d’objets fins, câbles ou trajectoires. Elle est particulièrement utile dans les cas où les objets sont trop fins ou allongés pour être annotés efficacement par bounding box ou polygone.

Définition des catégories d’éléments linéaires à annoter

Traçage manuel ou assisté de polylignes sur les images

Vérification de la continuité, précision et cohérence du tracé

Export dans des formats compatibles (JSON, GeoJSON, COCO adaptatif)

Inspection industrielle – Annotation de fissures, soudures, câblages

Conduite autonome – Tracé des marquages au sol ou trajectoires de véhicules

Imagerie satellite – Délimitation de routes, rivières ou lignes électriques

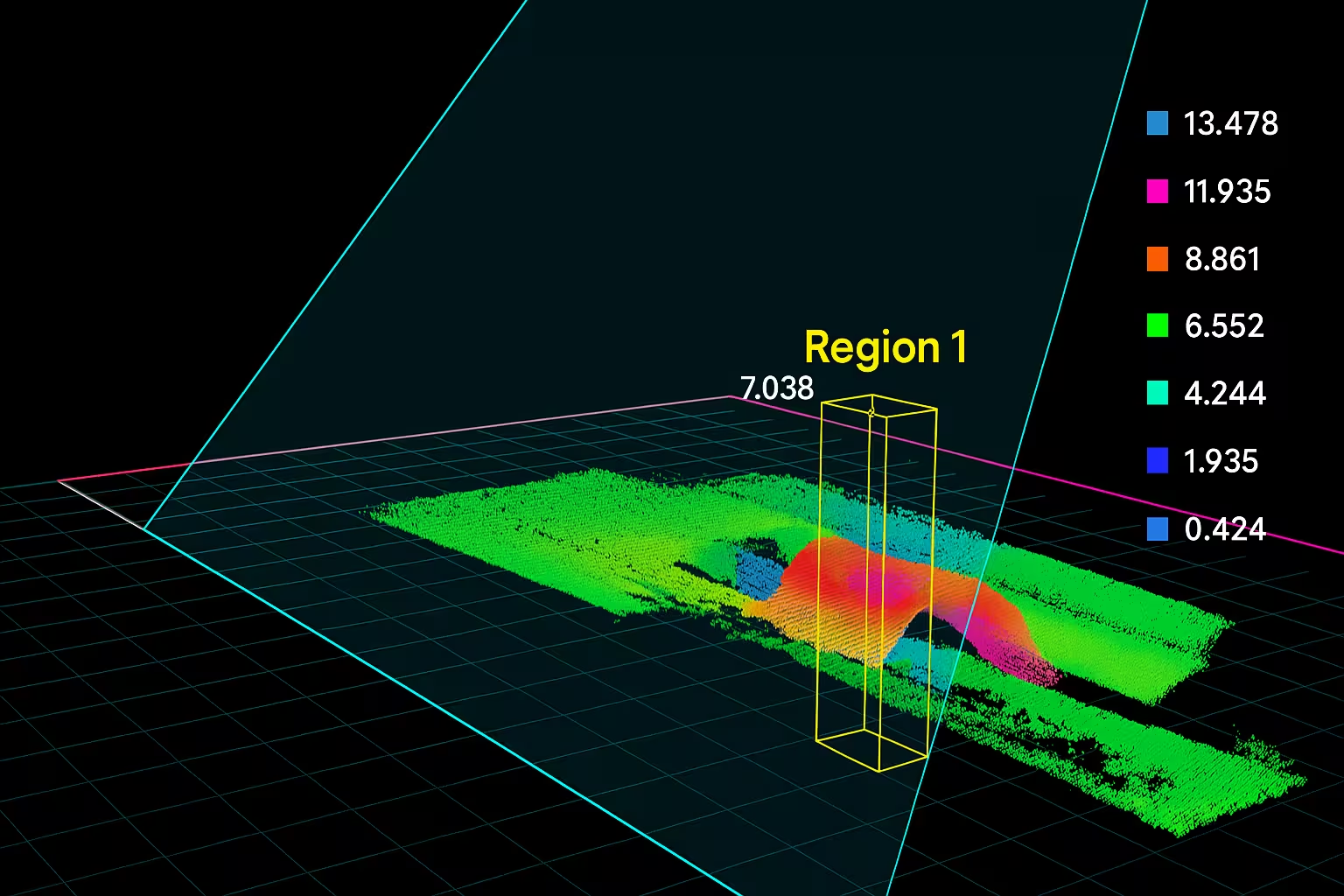

Cuboïdes

L’annotation par cuboïdes permet de délimiter des objets dans l’espace en trois dimensions à partir d’images 2D, de données LiDAR ou de séquences vidéo.Elle est indispensable pour entraîner des modèles de perception 3D dans des environnements complexes (conduite autonome, robotique, logistique…).

Définition des classes d’objets à modéliser en 3D

Placement manuel ou semi-automatisé des cuboïdes sur plusieurs vues ou nuages de points

Alignement et vérification des dimensions, orientation et profondeur

Export au format compatible (KITTI, PCD, JSON 3D, …)

Conduite autonome – Détection de véhicules et piétons avec estimation de la distance et du volume

Logistique – Localisation et dimensionnement de colis en entrepôt

Cartographie 3D – Annotation de bâtiments ou structures dans des environnements urbains

Annotation vidéo

Nous transformons vos vidéos en données exploitables pour l'IA grâce à une annotation experte, précise et adaptée à vos cas d’usage.

Object Tracking

L’Object Tracking consiste à suivre un ou plusieurs objets d’intérêt dans une séquence vidéo image par image, afin de modéliser leur trajectoire dans le temps.

Sélection des objets à suivre (voiture, personne, animal, produit, ...)

Annotation manuelle ou semi-automatique de la position image par image (bounding box, polygone, …)

Association cohérente d’un identifiant unique pour chaque objet suivi

Ajustement et interpolation des frames manquantes si nécessaire

Conduite autonome – Suivi de piétons et véhicules dans un environnement urbain

Retail – Analyse du parcours client en magasin pour étudier les comportements d’achat

Sport – Tracking de joueurs pour la modélisation des performances ou la création de statistiques en temps réel

Action Recognition

Annoter des séquences vidéo contenant des gestes ou comportements spécifiques (ex. : courir, tomber, lever un objet…), afin d’entraîner des modèles capables de reconnaître automatiquement des actions dans une vidéo.

Définition du catalogue d’actions à détecter (liste exhaustive, par domaine)

Détection et sélection des segments vidéo où ces actions se produisent

Annotation temporelle avec début/fin de l’action + label associé

Structuration et export au format compatible (ex. : JSON, CSV, frame range + label)

Sport – Reconnaissance des gestes techniques dans l'entraînement vidéo (ex. : dribbles, sauts, passes)

Sécurité – Détection d’actions suspectes (ex. : bagarre, intrusion, abandon d’objet)

Santé – Détection automatique des chutes ou mouvements inhabituels en maison de retraite

Event Detection

Annoter des événements clés ou inhabituels survenant dans une vidéo, avec une dimension temporelle marquée (début/fin), sans forcément impliquer une action continue.

Identification des types d’événements à annoter (ex. : collision, ouverture de porte, alarme déclenchée, …)

Annotation temporelle de chaque événement (timestamp ou plage de frames) avec le label correspondant

Vérification et validation des occurrences pour éviter les faux positifs

Export des annotations (ex. : CSV, JSON, avec timestamp + type d’événement)

e-Learning – Marquage automatique de moments pédagogiques clés (ex. : prise de parole, démonstration, moment de confusion)

Industrie – Repérage d’incidents de production (blocage machine, chute d’objet, arrêt ligne)

Sécurité – Détection d’intrusions, de comportements anormaux ou de mouvements non autorisés

Classification temporelle

Attribuer des labels globaux ou contextuels à des séquences continues d’une vidéo, en les segmentant selon des périodes cohérentes (ex. : calme / activité / alerte).

Définition des catégories temporelles à annoter (états, situations, niveaux d’activité, ...)

Annotation des plages temporelles avec un label unique par segment

Relecture et vérification de la cohérence entre les transitions

Export des segments annotés avec début/fin + classe associée (formats : JSON, CSV, XML, …)

Études comportementales – Repérage des phases : attention soutenue / distraction / fatigue

Circulation – Classification des séquences : fluide / dense / bloquée

Monitoring – Segmentation des périodes : actif / inactif / erreur système

Pose Estimation

Annoter les positions corporelles (keypoints) image par image dans une séquence vidéo, afin de modéliser les mouvements d’un ou plusieurs individus dans le temps.

Définition du squelette de keypoints (ex. : 17 points – tête, épaules, coudes, genoux, …)

Annotation des points clés sur chaque frame ou par keyframes avec interpolation

Relecture et correction manuelle en cas d’occlusion ou d’ambiguïté

Export dans des formats spécialisés (COCO keypoints, JSON structuré, CSV par frame)

Sport – Étude du geste technique (lancer, saut, frappe…) dans l’entraînement vidéo

Surveillance – Détection d’attitudes suspectes ou d’anomalies motrices

Santé / Rééducation – Analyse de la posture et des amplitudes articulaires

Interpolation

Générer automatiquement les annotations manquantes entre plusieurs images clés (keyframes) dans une vidéo. Cette technique est utilisée pour accélérer l’annotation manuelle, tout en conservant une précision suffisante pour l’entraînement de modèles IA. Cette méthode est applicable à différents types d’annotations : bounding boxes, polygones, keypoints, etc.

Annotation manuelle d’objets ou points sur des frames clés (tous les X frames)

Activation de l’interpolation automatique dans l’outil d’annotation (CVAT, Label Studio, Encord, ...)

Vérification des interpolations générées : trajectoires, formes, cohérence

Ajustement manuel des frames où l’interpolation est incorrecte

Robotique logistique – Animation fluide du déplacement d’objets entre deux positions

Vidéos embarquées – Suivi fluide de véhicules ou piétons sans annoter chaque frame

Production multimédia – Annotation accélérée de séquences longues pour segmentation ou tracking

Annotation 3D Point Cloud

Nous structurons vos nuages de points en données 3D exploitables grâce à une annotation experte et adaptée à vos modèles IA

Etiquetage de points

Annoter chaque point d’un nuage de points 3D avec une classe spécifique (ex. : sol, véhicule, piéton, végétation, ...). Cette méthode est utilisée pour entraîner des modèles de segmentation sémantique 3D, utilisés en robotique, conduite autonome ou cartographie.

Chargement du nuage de points brut (données LiDAR, photogrammétrie, etc.)

Sélection des classes à appliquer (ex. : route, trottoir, bâtiment, arbre, voiture, …)

Annotation manuelle ou assistée de chaque point ou de groupes de points (via sélection 3D, brosses, volumes)

Export des données annotées sous format compatible (ex. : .las, .pcd, .json)

Conduite autonome – Segmentation précise des éléments de la route dans des scènes urbaines ou autoroutières

Cartographie HD – Classification fine des points pour générer des cartes 3D structurées

Robotique industrielle – Identification d’objets ou d’obstacles dans un environnement 3D pour navigation autonome

Maillages

Etiqueter des surfaces 3D composées de triangles ou polygones connectés, souvent dérivées de scans LiDAR ou photogrammétriques. Pour une segmentation plus précise des formes et volumes que les annotations sur points seuls, en capturant la topologie réelle des objets.

Identification des objets à annoter

Encadrement précis des objets

Étiquetage des catégories

Validation des annotations

Médecine – Annotation de surfaces anatomiques (os, organes) sur des modèles 3D issus d’IRM ou de scanners

AR/VR / 3D Modeling – Étiquetage de composants d’objets 3D pour interactions ou simulations physiques

Architecture / BTP – Identification de matériaux ou de structures sur des modèles 3D de bâtiments

Nuages de points

Identifier, segmenter ou classer des objets dans un espace tridimensionnel capturé via LiDAR ou photogrammétrie. Elle peut prendre la forme de cuboïdes 3D, zones segmentées, ou étiquetage de points, et permet d'entraîner des modèles de perception en environnement réel.

Chargement des données brutes (ex. : .las, .pcd, .bin, .json) dans un outil 3D dédié

Visualisation du nuage de points avec outils de navigation spatiale (rotation, zoom, sélection)

Annotation par volume (cuboïde), sélection libre (lasso, pinceau), ou point par point

Attribution des classes à chaque objet ou segment (véhicule, piéton, arbre, façade, etc.)

Véhicules autonomes – Détection 3D d’objets et de zones dans des scènes complexes

Robotique – Repérage d’obstacles, d’objets cibles ou de zones de navigation dans un espace 3D

Smart city / cartographie – Structuration des éléments urbains à partir de scans aériens ou mobiles

Surfaces planes

Une surface plane désigne une zone du nuage de points où les données présentent une distribution régulière et alignée sur un même plan géométrique.

Chargement du nuage de points 3D dans un outil de visualisation compatible

Annotation manuelle par sélection de zones planes

Attribution d’un label à chaque plan détecté

Export des surfaces avec les métadonnées (plan ID, label, orientation, coordonnées)

Scan d’intérieur – Identification automatique du sol, des murs et des plafonds pour la modélisation BIM ou la réalité augmentée

Cartographie 3D – Détection de façades, toitures ou autres éléments architecturaux dans les scènes urbaines

Robotique mobile – Repérage de surfaces navigables (sols plats) pour la planification de trajectoire

Objets 3D

identifier et délimiter des entités complètes dans un nuage de points, en leur associant un label (ex. : voiture, piéton, arbre, …). Cette annotation peut se faire à l’aide de cuboïdes 3D, de sélections manuelles ou d’algorithmes de segmentation assistée.

Chargement du nuage de points (LiDAR terrestre, mobile ou aérien)

Annotation de chaque objet détecté avec un identifiant et une classe

Vérification des contours, de l'orientation et de la complétude des objets

Export des annotations au format compatible

Environnement – Repérage et comptage d’arbres dans des relevés LiDAR aériens

Industrie – Identification d’objets ou équipements dans des scans 3D d’usines ou entrepôts

Conduite autonome – Détection et suivi 3D de véhicules, piétons, cyclistes dans l’environnement routier

3D Object Tracking

Identifier un même objet dans un nuage de points à travers plusieurs frames successives, en lui attribuant un identifiant unique persistant. Cette annotation permet d’entraîner des modèles capables de suivre les objets en mouvement dans l’espace 3D.

Annotation initiale des objets dans chaque frame (ex. : via cuboïdes ou segmentation)

Attribution d’un ID unique par objet pour le lier à travers les frames

Suivi manuel ou semi-automatique de la position et des dimensions de l’objet au fil du temps

Export des données avec identifiants temporels (frame, object ID, position 3D, classe)

Véhicules autonomes – Suivi continu de piétons, voitures, deux-roues dans un flux LiDAR

Robotique logistique – Suivi de colis ou d’objets manipulés dans un entrepôt

Sécurité – Tracking 3D de personnes ou engins dans des environnements surveillés

Annotations médicales

Nous transformons vos images médicales en données fiables grâce à une annotation experte, rigoureuse et conforme aux exigences cliniques.

Bounding Boxes

Délimiter des zones d’intérêt (ex. : anomalies, organes, dispositifs médicaux) sur des images 2D issues d’examens tels que radiographies, IRM ou échographies. Cette méthode rapide et structurée permet d’entraîner des modèles de détection automatique dans des contextes cliniques.

Chargement des images médicales (format DICOM, PNG, JPEG, etc.) dans un outil d’annotation compatible

Sélection des classes à annoter (lésion, tumeur, implant, os, etc.)

Annotation manuelle des régions d’intérêt à l’aide de rectangles (bounding boxes)

Export des annotations au format standard (ex. : COCO, Pascal VOC, YOLO)

Radiologie – Détection de fractures ou d’implants sur des radiographies

Pneumologie – Identification de nodules ou opacités sur des radiographies thoraciques

Neurologie – Annotation de masses suspectes sur des coupes IRM cérébrales

Polygones

Délimiter précisément les contours d’organes, de lésions ou d’implants sur des images médicales 2D. Contrairement aux bounding boxes, elle offre une meilleure précision pour les structures irrégulières ou complexes, essentielle pour la segmentation fine en imagerie médicale.

Import des images médicales (radiographie, IRM, échographie, etc.)

Définition des classes anatomiques ou pathologiques à segmenter

Annotation manuelle des contours à l’aide de polygones point par point (ou outils de dessin libres)

Export au format mask (PNG), COCO segmentation, ou formats personnalisés pour la segmentation

Oncologie – Segmentation des nodules pulmonaires ou masses sur CT scans

Orthopédie – Contour d’articulations ou zones osseuses sur radiographies

Neurologie – Délimitation précise de tumeurs ou d’aires cérébrales sur IRM

Segmentation en masques

Attribuer un label à chaque pixel d’une image médicale afin de délimiter avec précision une structure anatomique ou une anomalie. Pour entraîner des modèles de segmentation sémantique ou d’instance, en particulier dans les tâches nécessitant une compréhension fine des formes et volumes.

Import des images médicales (DICOM, PNG, NIfTI, etc.) dans un outil de segmentation

Définition des classes à segmenter (organe, lésion, prothèse, …)

Annotation manuelle ou semi-automatique pixel par pixel ou par zone (brosse, contour actif, assistée par l'IA? etc.)

Export sous forme de masques binaires ou multicanaux (PNG, NIfTI, COCO RLE, etc.)

Neuro-imagerie – Segmentation des ventricules, tumeurs ou régions fonctionnelles du cerveau

Oncologie – Délimitation fine des tumeurs pour la radiothérapie ou le suivi de progression

Imagerie musculo-squelettique – Segmentation de structures osseuses ou articulaires sur IRM ou scanner

Zones en 3D (Volume Annotation)

Délimiter des régions d’intérêt au sein d’un volume médical (IRM, scanner, etc.), en annotant voxel par voxel ou par segmentations interpolées à travers les coupes.

Chargement du volume 3D (formats DICOM, NIfTI, etc.) dans un logiciel de visualisation médicale

Sélection de la structure à annoter (ex. : tumeur, organe, cavité)

Annotation manuelle ou semi-automatisée sur les différentes coupes (axiale, coronale, sagittale)

Export du masque 3D segmenté au format compatible (NIfTI, MHD, volumetric PNGs, …)

Radiothérapie – Contour des organes à risque et des volumes cibles pour calcul de dose

Neurochirurgie – Délimitation volumique de tumeurs cérébrales pour planification opératoire

Recherche clinique – Annotation d’organes entiers (foie, reins, cœur, ...) pour entraînement de modèles de segmentation 3D

Contours et courbes

Tracer précisément les frontières de structures anatomiques ou pathologiques sur des images médicales 2D, en suivant manuellement ou semi-automatiquement les lignes naturelles d’un organe, d’une lésion ou d’un implant.

Import des images médicales (IRM, radiographies, échographies, ...)

Activation d’un outil de tracé libre ou courbe avec plateforme d'annotation

Fermeture de la courbe et validation de la précision du tracé

Export au format vectoriel ou rasterisé (SVG, JSON, PNG mask, …)

Neurologie – Annotation des limites de zones fonctionnelles cérébrales sur IRM anatomique

Cardiologie – Délimitation de la paroi du myocarde ou des cavités cardiaques sur IRM fonctionnelle

Orthopédie – Tracé des lignes articulaires ou des fissures sur des radiographies

Points de référence (Landmarks)

Placer des points précis sur des repères anatomiques (landmarks) pour analyser la structure, la symétrie ou l’alignement d’une zone donnée. Elle est utilisée dans des tâches telles que la morphométrie, l’alignement d’images, ou comme support à d’autres types d’annotations (segmentation, mesures, suivi).

Chargement de l’image médicale (IRM, TDM, radiographie, etc.) dans un outil d’annotation

Positionnement manuel des points sur des structures précises (ex. : apex du cœur, condyle fémoral, commissures)

Vérification de la cohérence des positions et distances

Export des coordonnées (CSV, JSON, XML, ou format propriétaire selon outil)

Odontologie – Positionnement de landmarks crâniens sur des céphalogrammes pour analyse orthodontique

Orthopédie – Annotation de points d’alignement sur des radiographies pour planification d’implants ou prothèses

Neurochirurgie – Marquage de repères anatomiques pour l’alignement d’IRM préopératoires

Cas d’usage

Notre expertise couvre une large gamme de cas d’usage IA, quel que soit le domaine ou la complexité des données. Voici quelques exemples :

Pourquoi choisir

Innovatiana ?

Nous mobilisons une équipe d’experts flexible et expérimentée, maîtrisant l’annotation d’images et de vidéos via des approches manuelles, automatiques et hybrides. Nous produisons des datasets visuels adaptés à tous les cas d’usage en Computer Vision

Notre méthode

Une équipe de Data Labelers & AI Trainers professionnels, pilotée par des experts, pour créer et maintenir des ensembles de données de qualité pour vos projets IA (création de datasets sur mesure pour entraîner, tester et valider vos modèles de Machine Learning, Deep Learning ou NLP)

Nous vous proposons un accompagnement sur mesure en tenant compte de vos contraintes et échéances. Nous proposons des conseils portant sur votre processus et infrastructure de labellisation, le nombre de professionnels requis en fonction de votre besoin ou encore la nature des annotations à privilégier.

Dans un délai de 48 heures, nous évaluons votre besoin et réalisons un test si nécessaire, afin de vous proposer un contrat adapté à vos enjeux. Nous ne verrouillons pas la prestation : pas d’abonnement mensuel, pas d’engagement. Nous facturons au projet !

Nous mobilisons une équipe de Data Labelers ou AI Trainers. Cette équipe est pilotée par l'un de nos Data Labeling Managers : votre contact privilégié.

Vous témoignez

🤝 L’éthique au cœur de nos valeurs

De nombreuses sociétés de Data Labeling opèrent avec des pratiques discutables dans des pays à faible revenu. Nous proposons une alternative éthique et impactante.

Des emplois stables et équitables, avec une transparence totale sur l'origine des données

Une équipe de Data Labelers formée, équitablement rémunérée et accompagnée dans son évolution

Une tarification flexible à la tâche ou au projet, sans frais cachés ni engagement

Un développement vertueux à Madagascar (et ailleurs) via la formation et l'investissement local

Une protection maximale de vos données sensibles selon les meilleurs standards

L'accélération d'une IA éthique globale grâce à des équipes dédiées

🔍 L'IA commence par les données

Avant d'entraîner votre IA, la vraie charge de travail, c’est de concevoir le bon dataset. Découvrez ci-dessous comment construire un POC robuste en alignant données de qualité, architecture de modèle adaptée et ressources de calcul optimisées.

Alimentez vos modèles IA avec des données d'entraînement de haute qualité !

.webp)